Xã hội

TP.HCM thu hút và phát triển nguồn nhân lực sau đại học

TP.HCM đẩy mạnh thu hút và phát triển nguồn nhân lực sau đại học nhằm đáp ứng nhu cầu phát triển kinh tế - xã hội, với nhiều chính sách ưu đãi hấp dẫn.

Kinh tế

Lâm Đồng: Điểm dãn vui mừng nhờ vụ mưới kéo dài gia tăng

Nhờ thời tiết thuận lợi, vụ mưới tại Lâm Đồng kéo dài, sản lượng tăng cao, mang lại niềm vui cho người dân và thúc đẩy kinh tế địa phương.

Chính trị

Mâu thuẫn mua bán ô tô, hai thanh niên tạt mắm tôm ba căn nhà ở TP.HCM

Công an TP.HCM xử lý hai thanh niên vì tạt mắm tôm pha sơn vào ba căn nhà do mâu thuẫn mua bán ô tô.

Pháp luật

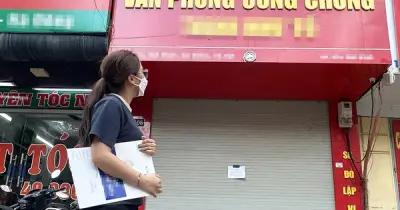

Nghị định 109/2026: Phạt đến 15 triệu đồng vi phạm công chứng bất động sản

Nghị định 109/2026 có hiệu lực từ 18.5, quy định mức phạt mới trong lĩnh vực công chứng, hôn nhân, thi hành án dân sự. Công chứng viên vi phạm chụp ảnh có thể bị phạt đến 10 triệu đồng.

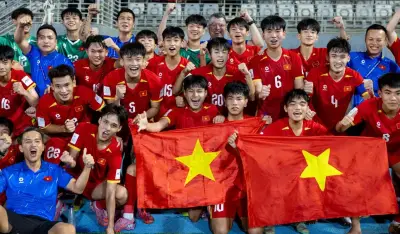

Thể thao

Công nghệ

Khoa học công nghệ: Chìa khóa vàng phát triển đất nước

Khoa học công nghệ được xem là chìa khóa vàng để hiện thực hóa mục tiêu phát triển đất nước, đưa Việt Nam trở thành quốc gia phát triển vào năm 2045.

Tắt đường kẻ ngang dưới biểu tượng pin iPhone

Hướng dẫn tắt đường kẻ ngang dưới biểu tượng pin iPhone bằng cách vô hiệu hóa Trung tâm điều khiển trên màn hình khóa, giúp tăng bảo mật và tránh gây khó chịu.

Quảng Ninh phát triển KHCN tạo động lực tăng trưởng mới

Quảng Ninh đẩy mạnh ứng dụng khoa học công nghệ, tạo đột phá trong phát triển kinh tế - xã hội, hướng đến tăng trưởng bền vững và nâng cao năng lực cạnh tranh.

Khơi thông nguồn lực cho KHCN và đổi mới sáng tạo là ưu tiên

Bộ KH&CN tổ chức lễ chào mừng Ngày Khoa học, Công nghệ và Đổi mới sáng tạo Việt Nam, nhấn mạnh khơi thông nguồn lực cho khoa học công nghệ là ưu tiên chiến lược, đồng thời triển khai công nghệ chiến lược quốc gia.

Mật khẩu đơn giản lỗi thời: Bảo vệ tài khoản trực tuyến

Rò rỉ dữ liệu và lừa đảo qua mạng khiến mật khẩu đơn giản trở nên lỗi thời. Tìm hiểu cách sử dụng trình quản lý mật khẩu, xác thực hai yếu tố và passkey để bảo vệ tài khoản trực tuyến.

Du lịch

Nhận tin mới

Đăng ký bản tin của chúng tôi để nhận những cập nhật mới nhất ngay trong hộp thư của bạn!

Chúng tôi không bao giờ gửi thư rác