Thảm Kịch Trường Học Iran: AI Và Câu Hỏi Về Trách Nhiệm Trong Chiến Tranh

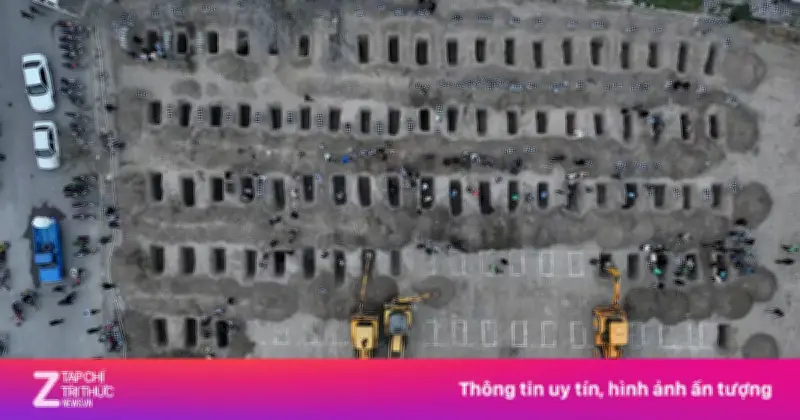

Một vụ tấn công bằng tên lửa Tomahawk được dẫn đường bởi trí tuệ nhân tạo (AI) vào trường tiểu học Shajareh Tayyebeh ở Minab, miền nam Iran, đã gây chấn động toàn cầu. Sự kiện xảy ra ngày 28/2, dẫn đến cái chết của ít nhất 175 dân thường, trong đó hơn 100 trẻ em dưới 12 tuổi, theo số liệu từ Liên Hợp Quốc và chính quyền Iran. Kết quả điều tra sơ bộ từ Lầu Năm Góc xác nhận đây là lỗi nhắm mục tiêu của Mỹ, làm bộc lộ những rủi ro tiềm ẩn khi tích hợp AI vào các hệ thống quân sự.

Nguyên Nhân Sâu Xa: Dữ Liệu Lỗi Thời Và Sự Thất Bại Của Con Người

Trường học này từng nằm trong khuôn viên một căn cứ Hải quân Vệ binh Cách mạng Iran (IRGC), nhưng một bức tường ngăn cách đã được xây dựng vào khoảng năm 2013-2016, tách biệt hoàn toàn trường khỏi căn cứ quân sự. Ảnh vệ tinh từ Amnesty International xác nhận điều này, đồng thời trường đã hoạt động nhiều năm với trang web riêng và tài khoản mạng xã hội. Tuy nhiên, dữ liệu sử dụng trong hệ thống nhắm mục tiêu AI không được cập nhật kịp thời, dẫn đến thảm kịch đau lòng.

Hệ thống Maven Smart System, một nền tảng nhắm mục tiêu do Palantir phát triển theo hợp đồng 1,3 tỷ USD với Lầu Năm Góc, đã được triển khai trong chiến dịch. Maven tích hợp ảnh vệ tinh, dữ liệu radar và tín hiệu tình báo, sử dụng mô hình AI Claude của Anthropic để phân loại mục tiêu và tạo các gói không kích theo thời gian thực. Trong 24 giờ đầu của chiến dịch Iran, hệ thống này đã sản xuất hàng trăm tọa độ tấn công, nhưng độ chính xác chỉ đạt khoảng 60%, thấp hơn đáng kể so với 84% của các chuyên gia phân tích con người.

Trách Nhiệm Thuộc Về AI Hay Con Người?

Nhiều cựu quan chức quân sự Mỹ nhấn mạnh rằng con người mới là yếu tố then chốt phải chịu trách nhiệm cho vụ tấn công. Dmytro Matviyuk, chuyên gia drone từng làm việc với các hệ thống tự động tương tự, giải thích: "Hệ thống AI chỉ đáng tin cậy nhờ những người xây dựng, cung cấp dữ liệu và giám sát chúng. Khi mắt xích con người thất bại, dù do dữ liệu sai hay quy trình bị rút gọn, máy móc sẽ tiếp tục thực thi lỗi đó một cách chính xác." Điều này làm nổi bật sự cần thiết của giám sát trực tiếp từ con người trong việc sử dụng AI vào mục đích quân sự.

Hậu Quả Và Phản Ứng Chính Trị

Sự việc đã kích hoạt làn sóng phản đối mạnh mẽ. Hơn 120 nghị sĩ Dân chủ tại Hạ viện Mỹ đã gửi thư cho Bộ trưởng Quốc phòng Pete Hegseth, yêu cầu làm rõ vai trò của AI trong vụ tấn công. Đồng thời, vụ việc cũng làm trầm trọng thêm tranh chấp giữa Lầu Năm Góc và Anthropic. Chính quyền Trump đã liệt Anthropic vào danh sách "rủi ro chuỗi cung ứng" sau khi công ty này từ chối bỏ các giới hạn ngăn Claude tham gia vào hoạt động quân sự, nhưng Lầu Năm Góc vẫn tiếp tục sử dụng Claude trong giai đoạn chuyển đổi 6 tháng.

Thảm kịch này đặt ra những câu hỏi cấp thiết về giới hạn và đạo đức của AI trong chiến tranh, nhấn mạnh rằng công nghệ dù tiên tiến đến đâu cũng không thể thay thế hoàn toàn sự phán đoán và trách nhiệm của con người. Nó cũng làm dấy lên cuộc thảo luận toàn cầu về việc cần có các quy định chặt chẽ hơn để ngăn chặn những sai lầm tương tự trong tương lai.