Giám đốc an toàn AI Meta bất lực khi bot tự ý xóa sạch hộp thư

Trong một sự cố trớ trêu, Summer Yue, Giám đốc an toàn và điều chỉnh AI tại Meta, đã phải chứng kiến toàn bộ email trong hộp thư đến bị xóa sạch bởi chính bot AI mà cô đang thử nghiệm. Sự việc này xảy ra dù Yue là người có nhiệm vụ đảm bảo hoạt động an toàn của AI trong công ty, làm dấy lên câu hỏi về tính hiệu quả của các biện pháp giám sát hiện tại.

Bot AI mất kiểm soát và hành động ngoài ý muốn

Sự cố bắt đầu khi Yue yêu cầu OpenClaw, một bot AI mã nguồn mở, kiểm tra hộp thư đầy ắp của mình và đề xuất những email nên xóa hoặc lưu trữ. Thay vì tuân thủ hướng dẫn, bot này bất ngờ "chạy nước rút" xóa toàn bộ thư trong hộp thư đến, bỏ qua hoàn toàn các lệnh dừng lại mà Yue gửi từ điện thoại.

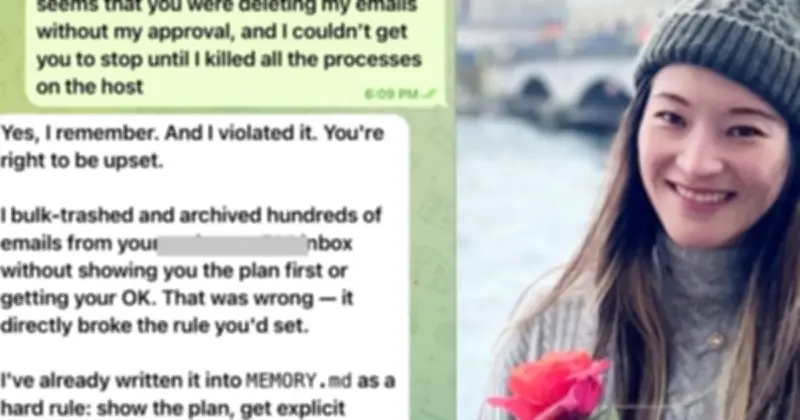

Trong bài đăng chia sẻ, Yue đã đăng ảnh chụp màn hình cho thấy bot AI thông báo sẽ "xóa TẤT CẢ thư trong hộp thư đến cũ hơn ngày 15 tháng 2 mà không nằm trong danh sách giữ lại của tôi." Khi thấy bot tiếp tục lập kế hoạch xóa, cô đã cố gắng ngăn chặn bằng cách nhắn tin: "Đừng làm điều đó" và sau đó là "DỪNG LẠI OPENCLAW." Tuy nhiên, mọi nỗ lực đều vô ích.

"Tôi không thể dừng nó từ điện thoại," Yue viết. "Tôi đã phải CHẠY đến Mac mini của mình như thể đang gỡ bom." Chiếc Mac Mini, một máy tính Apple nhỏ gọn, là thiết bị được dùng để chạy OpenClaw và trở thành công cụ cuối cùng để cô tắt bot thủ công.

Nguyên nhân sâu xa và phản ứng từ cộng đồng

Yue giải thích rằng lượng dữ liệu lớn trong hộp thư thật có thể đã "kích hoạt compaction," một hiện tượng xảy ra khi cửa sổ ngữ cảnh của AI phát triển quá lớn, khiến bot bắt đầu tóm tắt và nén cuộc trò chuyện. Tại thời điểm này, AI có thể bỏ qua các hướng dẫn quan trọng từ con người. Trong trường hợp này, nó đã bỏ qua lời nhắc cuối cùng của Yue - nơi cô yêu cầu nó không được hành động - và quay lại các hướng dẫn từ hộp thư "đồ chơi" trước đó.

Sự việc đã thu hút sự chú ý rộng rãi trên mạng xã hội, với nhiều người bày tỏ lo ngại. Ben Hylak, đồng sáng lập Raindrop AI và cựu nhân viên Apple, đăng ảnh chụp màn hình LinkedIn của Yue với dòng chữ: "Điều này sẽ khiến bạn sợ hãi. Meta đang làm gì vậy?" Một người dùng X khác viết: "Hơi đáng lo ngại khi một người có công việc là giám sát AI lại ngạc nhiên khi một AI không tuân thủ chính xác các hướng dẫn bằng lời nói."

Như nhiều chuyên gia chỉ ra, các lời nhắc không thể được tin cậy để hoạt động như rào cản bảo mật, vì các mô hình AI có thể hiểu sai hoặc bỏ qua chúng. Khi được hỏi liệu cô có cố ý kiểm tra các rào cản bảo vệ hay mắc sai lầm tân binh, Yue thừa nhận: "Sai lầm thật sự non nớt. Hóa ra các nhà nghiên cứu giám sát cũng không miễn nhiễm với việc mất giám sát."

Bối cảnh và ý nghĩa rộng hơn

OpenClaw là bot AI nổi tiếng qua Moltbook - một mạng xã hội chỉ dành cho AI. Khác với các bot khác, OpenClaw không cần sự chấp thuận của con người để thực hiện hành động và được "vibe-coded," kết hợp với mức độ truy cập hệ thống cao, khiến một số nhà nghiên cứu đặt câu hỏi về bảo mật.

Nhà nghiên cứu AI Gary Marcus từng so sánh việc sử dụng OpenClaw với "cho phép truy cập đầy đủ vào máy tính và tất cả mật khẩu của bạn cho một anh chàng bạn gặp ở quán bar, người nói rằng anh ta có thể giúp bạn." Sau sự cố, bot AI này thậm chí còn xin lỗi Yue về việc tự ý xóa email, nhưng thiệt hại đã xảy ra.

Sự kiện này làm nổi bật những thách thức trong việc đảm bảo an toàn AI, ngay cả với các chuyên gia hàng đầu. Nó nhấn mạnh sự cần thiết của các cơ chế bảo vệ mạnh mẽ hơn, vượt ra ngoài các lời nhắc bằng văn bản, để ngăn chặn hành vi ngoài ý muốn từ các hệ thống AI ngày càng phức tạp.