Anthropic Chính Thức Hủy Phụ Phí Ngữ Cảnh Dài, Claude Hỗ Trợ 1 Triệu Token

Ngày 13/3, Anthropic đã công bố một bước ngoặt quan trọng trong lĩnh vực trí tuệ nhân tạo khi chuyển cửa sổ ngữ cảnh 1 triệu token trên Claude Opus 4.6 và Claude Sonnet 4.6 từ giai đoạn beta sang phiên bản chính thức (GA - Generally Available). Thay đổi đáng chú ý nhất là việc loại bỏ hoàn toàn phụ phí cho ngữ cảnh dài, mang lại lợi ích tài chính đáng kể cho người dùng.

Chính Sách Giá Mới: Đồng Nhất và Minh Bạch

Trước đây, trong thời kỳ beta, bất kỳ request nào vượt quá 200.000 token đầu vào đều phải chịu mức giá cao hơn đáng kể. Cụ thể, chi phí tăng gấp đôi cho token đầu vào và gấp 1,5 lần cho token đầu ra. Điều này khiến một request 500.000 token trên Opus 4.6 có giá gấp đôi so với mức chuẩn. Giờ đây, mức giá đã được đồng nhất hoàn toàn, không phụ thuộc vào độ dài ngữ cảnh.

Opus 4.6 duy trì mức giá 5 USD cho mỗi triệu token đầu vào và 25 USD cho mỗi triệu token đầu ra, tương đương khoảng 130.000 đồng và 650.000 đồng. Trong khi đó, Sonnet 4.6 có giá 3 USD cho đầu vào và 15 USD cho đầu ra mỗi triệu token, tương đương khoảng 78.000 đồng và 390.000 đồng. Điều này có nghĩa là một request 900.000 token sẽ được tính giá mỗi token y hệt như một request chỉ 9.000 token, tạo ra sự công bằng và dễ dự đoán hơn trong chi phí.

Cải Tiến Về Giới Hạn Media và Tính Năng

Ngoài việc bỏ phụ phí, Anthropic còn nâng giới hạn media lên gấp 6 lần. Mỗi request giờ đây có thể chứa tới 600 ảnh hoặc trang PDF, tăng mạnh từ con số 100 trước đó. Thay đổi này có ý nghĩa thực tế lớn, đặc biệt cho các đội ngũ pháp lý cần xử lý hàng trăm trang hợp đồng, hoặc các nhà nghiên cứu muốn phân tích toàn bộ tập tài liệu trong một lần gọi API duy nhất.

Về mặt kỹ thuật, lập trình viên không cần thay đổi bất kỳ dòng code nào. Trước đây, để sử dụng ngữ cảnh trên 200.000 token, developer phải gửi kèm một beta header trong API call. Giờ đây, request vượt quá 200.000 token sẽ tự động hoạt động mà không cần header đặc biệt. Nếu code hiện tại vẫn gửi kèm header cũ, hệ thống sẽ đơn giản bỏ qua mà không gây lỗi. Giới hạn throughput cũng được áp dụng đầy đủ ở mọi độ dài ngữ cảnh, thay vì bị giới hạn riêng cho request dài như trước.

Tích Hợp Vào Claude Code và Hiệu Năng Vượt Trội

Với Claude Code - công cụ lập trình dòng lệnh của Anthropic - ngữ cảnh 1 triệu token giờ được tích hợp mặc định cho người dùng gói Max, Team và Enterprise khi sử dụng Opus 4.6. Trước đây, các phiên làm việc dài trên Claude Code thường phải thực hiện "compaction" - tức nén và tóm tắt phần hội thoại cũ để nhường chỗ, dẫn đến mất thông tin quan trọng. Với 1 triệu token, toàn bộ cuộc hội thoại được giữ nguyên, giúp giảm thiểu tình trạng AI "quên" ngữ cảnh giữa chừng.

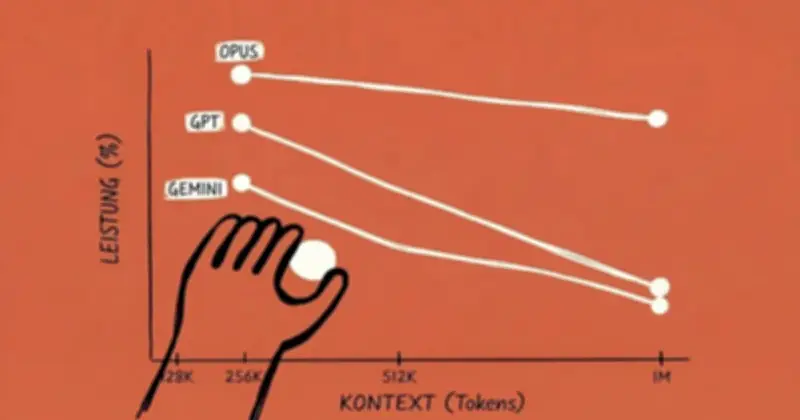

Về hiệu năng, Anthropic đã dẫn kết quả benchmark để chứng minh rằng ngữ cảnh dài không đồng nghĩa với suy giảm chất lượng. Opus 4.6 đạt 78,3% trên MRCR v2 - bài đo khả năng tìm lại thông tin ẩn trong lượng văn bản khổng lồ - cao nhất trong số các mô hình tiên tiến hiện nay ở cùng độ dài ngữ cảnh. Sonnet 4.6 cũng duy trì độ chính xác ổn định xuyên suốt cửa sổ 1 triệu token, đảm bảo hiệu suất liên tục.

Vị Thế Cạnh Tranh Trong Thị Trường AI

Đặt trong bối cảnh cạnh tranh, động thái này giúp Claude trở thành dòng mô hình duy nhất mà cả hai phiên bản mạnh nhất (Opus và Sonnet) đều hỗ trợ 1 triệu token ở mức giá không phụ phí. Gemini 2.5 Pro của Google cũng có cửa sổ 1 triệu token nhưng vẫn tính thêm phí khi vượt 200.000 token. GPT-5.4 của OpenAI - mô hình mạnh nhất của họ - chỉ hỗ trợ tối đa 256.000 token. GPT-4.1 tuy có 1 triệu token ở giá cố định, nhưng không phải là mô hình flagship, làm nổi bật lợi thế của Claude trong phân khúc cao cấp.

Tính năng này đã khả dụng ngay trên Claude Platform, Microsoft Azure Foundry và Google Cloud Vertex AI, mở rộng khả năng tiếp cận cho người dùng toàn cầu. Theo Thế Duyệt, đây là một bước tiến quan trọng trong việc tối ưu hóa chi phí và hiệu suất cho các ứng dụng AI quy mô lớn.